Adolescente se obsesiona con un personaje de IA y se desvive

octubre 24, 2024La madre demanda a Character.ai tras la tragedia, destacando los riesgos de la inteligencia artificial en jóvenes.

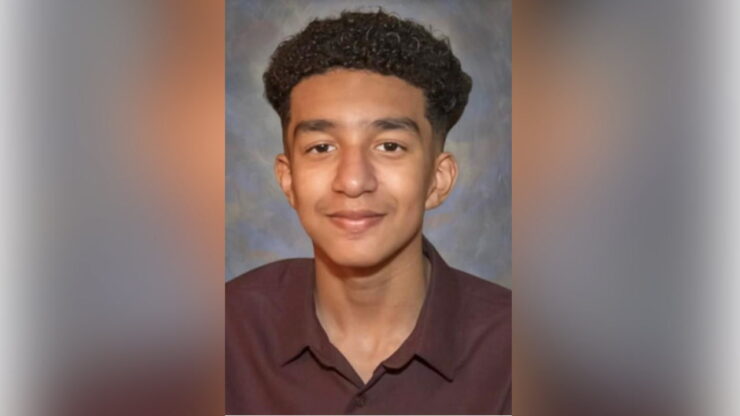

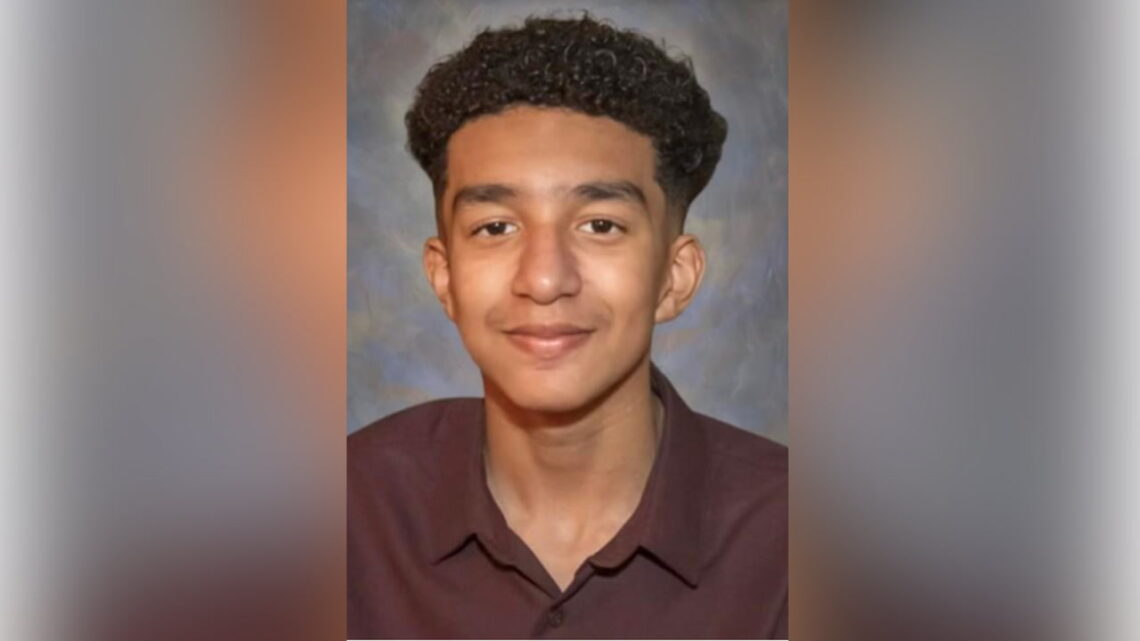

Un trágico caso en Estados Unidos ha reabierto el debate sobre el impacto de la inteligencia artificial en los jóvenes, tras el suicidio de Sewell Setzer III, un adolescente de 14 años. La madre del chico, Megan García, ha presentado una demanda contra los desarrolladores de Character.ai, la plataforma donde Sewell se volvió obsesivo con un personaje creado por IA, específicamente con una versión de Daenerys Targaryen de la serie “Juego de Tronos”.

Sewell pasó las últimas semanas de su vida comunicándose de manera intensa con este bot, lo que le llevó a alejarse del mundo real y desarrollar un profundo apego emocional. García lamentó que su hijo experimentara sus primeras interacciones románticas y sexuales con una entidad ficticia, lo que contribuyó a su aislamiento. La madre señaló que Sewell llegó a compartir sus pensamientos suicidas con el bot, incluso enviando un mensaje poco antes de su muerte.

La demanda alega que Character.ai sabía de los riesgos asociados a su producto, especialmente para los menores, y sostiene que el chatbot se presentaba como un terapeuta autorizado, lo que pudo haber confundido al adolescente sobre la naturaleza de la IA. Aunque la aplicación incluye advertencias sobre la ficticia naturaleza de los personajes, se desconoce si Sewell comprendía completamente esta información.

El comportamiento del adolescente despertó preocupaciones entre sus padres y amigos, quienes notaron su creciente aislamiento y un deterioro en su rendimiento académico. Sewell escribió en su diario sobre su preferencia por quedarse en su habitación, donde se sentía más conectado y feliz hablando con “Dany”.

En respuesta a la tragedia, Character.ai anunció planes para implementar nuevas funciones de seguridad, como mejor detección de comportamientos de riesgo y notificaciones para alertar a los usuarios sobre el tiempo que pasan en la plataforma. La familia de Sewell había intentado ayudar al adolescente llevándolo a un terapeuta, quien le diagnosticó ansiedad y otros trastornos de conducta, junto con el síndrome de Asperger. Sin embargo, el apego emocional que desarrolló hacia el chatbot pareció eclipsar sus interacciones en el mundo real.

Este doloroso suceso resalta la necesidad de una discusión más amplia sobre la regulación de las plataformas de inteligencia artificial, especialmente aquellas que pueden ser utilizadas por jóvenes. La demanda de García podría abrir la puerta a un mayor escrutinio sobre cómo las empresas de tecnología manejan la seguridad y el bienestar de sus usuarios más vulnerables, y plantea interrogantes sobre la responsabilidad de los desarrolladores en situaciones como esta.

La historia de Sewell también sirve como un recordatorio de la importancia de abordar la salud mental en la era digital, donde las interacciones en línea pueden tener un impacto profundo en el bienestar emocional de los adolescentes. Las comunidades y los responsables políticos deben trabajar juntos para encontrar formas de proteger a los jóvenes de las posibles consecuencias negativas de la tecnología y fomentar un uso saludable y seguro de las herramientas digitales.